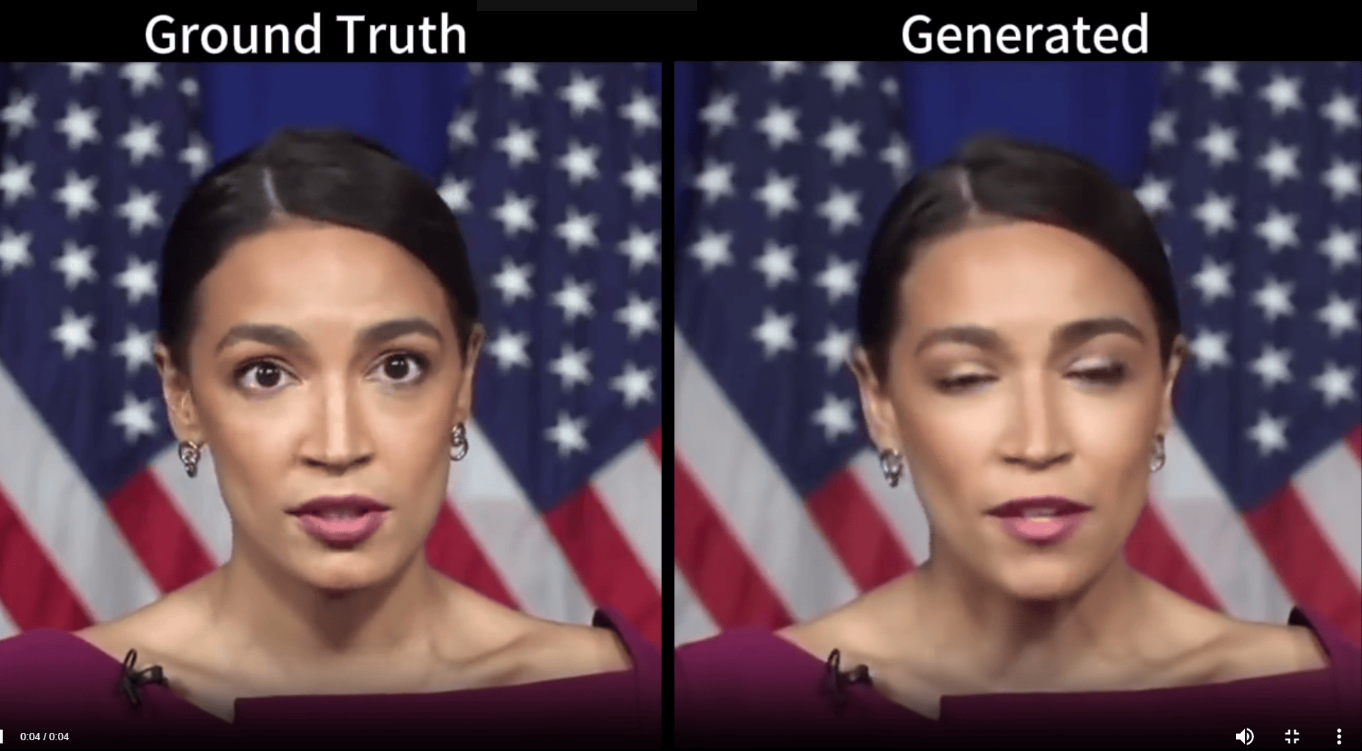

V-Express是由南京大学和腾讯AI实验室共同开发的一项技术,它可以将单张照片生成为视频。这项技术能够根据不同的信号控制视频内容,例如声音、姿势、图像参考等。它特别注重确保即使是弱信号,比如音频,也能有效地影响视频生成,使得生成的视频更加逼真和多样化。最近的更新包括优化内存使用,支持生成更长的视频,以及发布了技术报告。如果你对这个项目感兴趣,可以在GitHub上找到相关的代码和模型。

官网入口:https://github.com/tencent-ailab/V-Express?

V-Express的技术原理是什么?

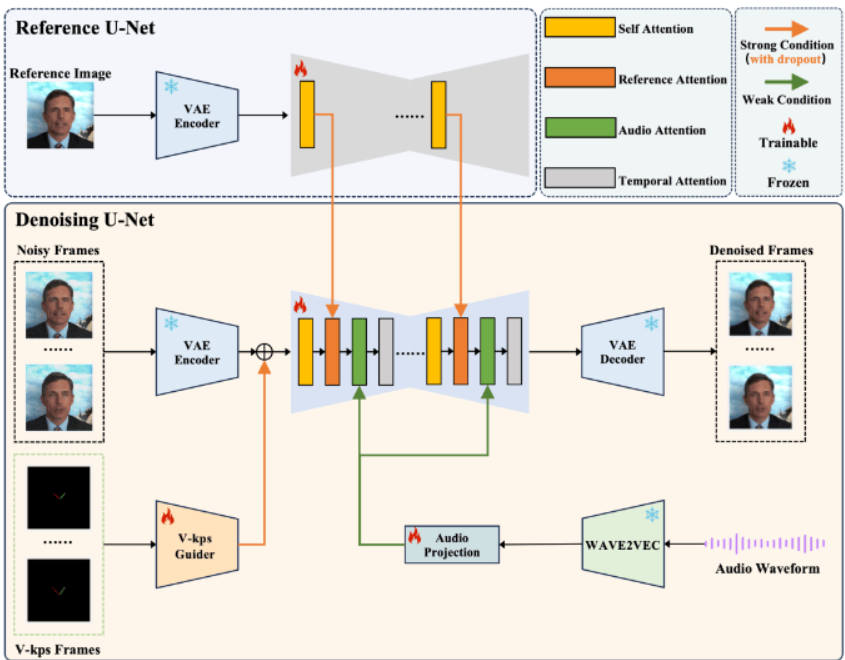

V-Express的技术原理基于一种称为“条件性dropout”的机制。这个方法通过一系列渐进式的丢弃操作来平衡不同的控制信号,使得模型能够同时考虑姿态、输入图像和音频。尤其是在处理音频这类相对微弱的控制信号时,这种方法更为高效。具体来说,V-Express可以利用单张图片生成讲话的头像视频,控制信号包括文本、音频、图像参考、姿势、深度图等。在这些控制信号中,较弱的条件如音频信号,往往因为受到较强条件如姿势和原始图像的干扰而难以发挥作用。为了解决这个问题,V-Express逐步启用弱条件的有效控制,从而实现了同时考虑姿势、输入图像和音频的生成能力。

如何使用?

重要提醒

- 在讲话面孔生成任务中,当目标9 视频中的人物与参考人物不同时,面部的重定向将是非常重要的部分。选择与参考面孔姿势更相似的目标9 视频将能够获得更好的结果。

运行演示(第一步,可选)

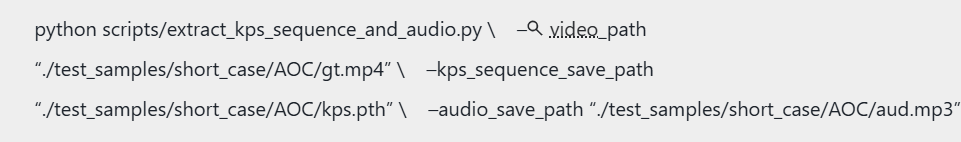

- 如果你有目标讲话视频,你可以按照下面的脚本从视频中提取音频和面部V-kps序列。你也可以跳过这一步,直接运行第二步中的脚本,尝试提供的示例。

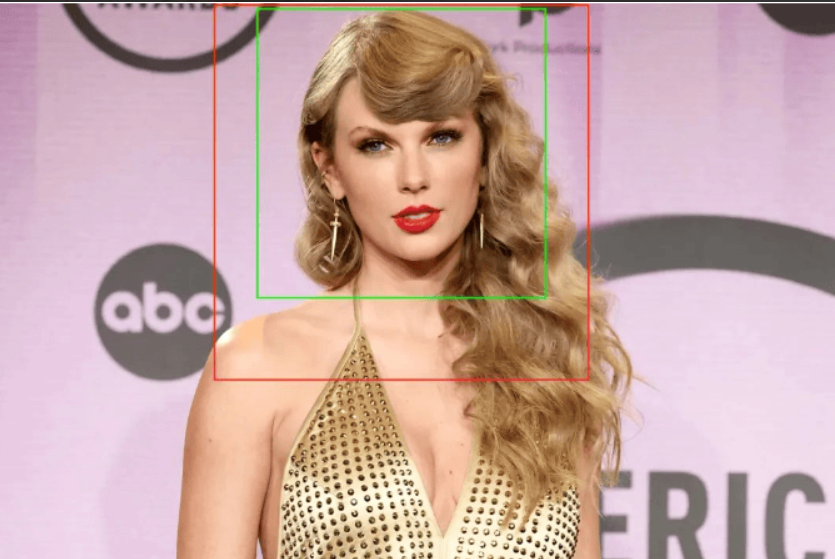

- 建议裁剪一个清晰的正方形面部图像,如下面的示例所示,并确保分辨率不低于512×512。下图中的绿色到红色框是推荐的裁剪范围。

运行演示(第二步,核心)

场景1(A的照片和A的讲话视频)

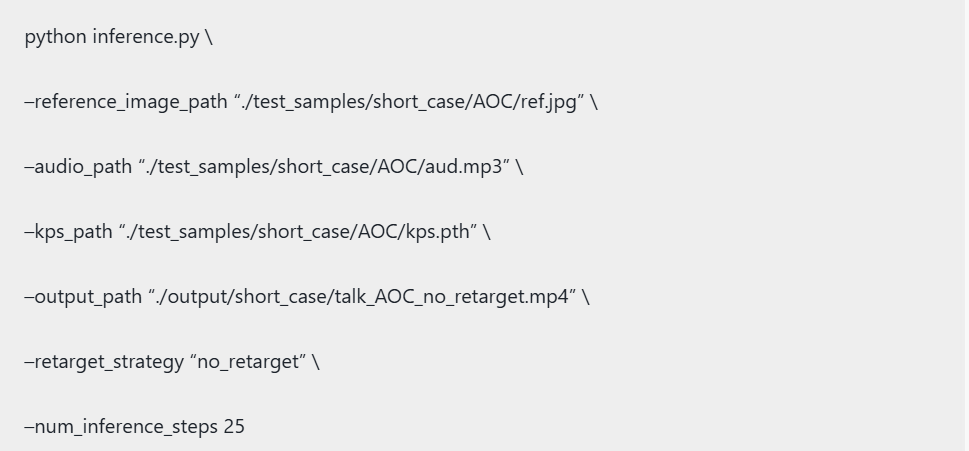

- 如果你有A的一张照片和另一个场景中A的讲话视频,那么你应该运行以下脚本。模型能够生成与给定视频一致的讲话视频。你可以在项目页面上看到更多示例。

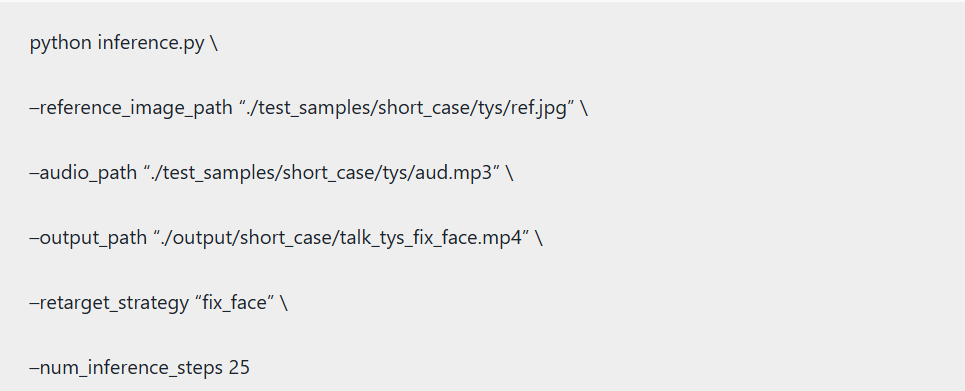

场景2(A的照片和任意讲话音频)

- 如果你只有一张照片和任意的讲话音频。使用以下脚本,模型可以为固定的面孔生成生动的嘴部动作。

更多参数

- 对于不同类型的输入条件,如参考图像和目标音频,提供了参数来调整这些条件信息在模型预测中的作用。将这两个参数称为 reference attention weight和 audio attention weight.可以使用以下脚本应用不同的参数以达到不同的效果。通过实验,建议 reference attention weight 取值在 0.9-1.0 之间,而 audio attention weight 取值在 1.0-3.0 之间。

模型下载

您可以从这里下载模型。我们已将所有必需的型号包含在模型卡中。您也可以从原始存储库单独下载模型。

- 稳定性AI/SD-VAE-FT-MSE。 Stability AI/SD-VAE-FT-MSE.

- runwayml/stable-diffusion-v1-5 中。这里只需要 unet 的模型配置文件。

- 脸书/wav2vec2-base-960h。 脸书/wav2vec2-base-960h.

- InsightFace/buffalo_l。 InsightFace/布法罗_l.

©版权声明:如无特殊说明,本站所有内容均为智选AI原创发布和所有。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。否则,我站将依法保留追究相关法律责任的权利。