MuseV由腾讯音乐娱乐的天琴实验室所研发,基于扩散的虚拟人类视频生成框架,主要用于生成高质量的虚拟人视频和口型同步。它支持从图像到视频、文本到图像到视频、视频到视频等多种生成方式,能够保持角色一致性,且不受视频长度限制。MuseV代表了虚拟人制作和AI新技术的发展方向。未来,它有望在娱乐、教育、会议等多个领域发挥重要作用,为用户带来更加丰富和真实的虚拟体验。

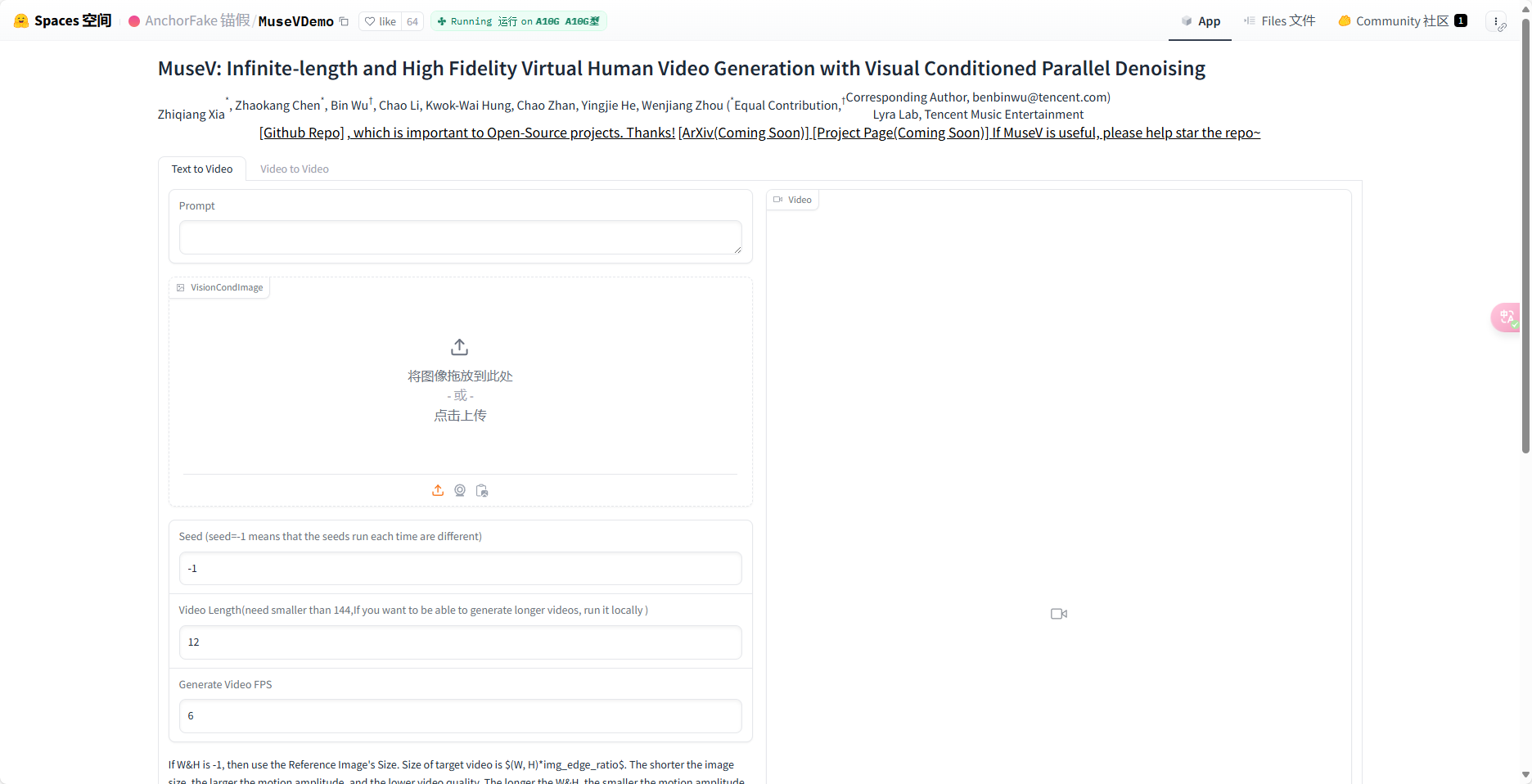

官网入口:https://huggingface.co/spaces/AnchorFake/MuseVDemo?ref

主要功能特点:

- 图生视频和口型生成:根据图像生成视频,并同步口型,适用于创建虚拟人物视频内容。

- 高一致性:生成的视频在画面和表情上保持高度一致性,使得虚拟人物看起来更自然和真实。

- 无限视频时长:采用新算法Parallel Denoising,理论上可以生成无限时长的视频,突破了以往模型的时间限制。

- 自定义动作:支持通过Openpose技术自定义动作生成,提供更大的创作自由度。

- 口型驱动技术:MuseV的口型生成技术(MuseTalk)准确自然,即将开源,进一步提升虚拟人物的语言表达能力。

- 多风格适应性:无论是写实风格还是二次元风格,MuseV都能生成效果稳定的视频。

- 快速视频生成:与其他模型相比,MuseV在视频生成速度上有显著优势,能够更快速地输出视频内容。

视频生成效果展示:

©版权声明:如无特殊说明,本站所有内容均为智选AI原创发布和所有。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。否则,我站将依法保留追究相关法律责任的权利。